VR系统

虚拟现实(VR)系统的技术演进与应用前景

虚拟现实(VR)系统的技术演进与应用前景

一、VR系统的技术构成

虚拟现实系统由硬件、软件和交互技术三部分组成,形成沉浸式数字体验的技术闭环:

1. 核心硬件设备:

– 头戴显示器(HMD):Meta Quest Pro采用Pancake光学模组,将设备厚度压缩40%,分辨率达1800×1920/眼

– 空间定位系统:Valve Lighthouse 2.0实现亚毫米级定位精度,SteamVR Tracking 2.0支持10×10米空间覆盖

– 体感交互设备:HaptX Gloves配备130个微气动制动器,实现0.6毫米精度触觉反馈

2. 软件架构:

– 图形渲染引擎:Unreal Engine 5的Nanite技术可实时渲染10亿多边形场景

– 物理引擎:NVIDIA PhysX 5.0支持分子级物质模拟

– 开发工具链:WebXR 1.0标准实现浏览器端VR内容即时加载

3. 关键技术突破:

– 眼动追踪:Tobii Spotlight技术使渲染分辨率动态分配,GPU负载降低40%

– 可变焦显示:Half Dome 3原型机实现动态屈光调节,解决视觉辐辏冲突

二、产业化应用场景

1. 工业制造:

– 波音采用VR进行飞机布线验证,使错误率下降70%,装配时间缩短30%

– 西门子NX VR设计平台实现多用户协同建模,设计评审效率提升50%

2. 医疗健康:

– Osso VR手术培训系统使骨科手术熟练度提升230%

– MindMaze神经康复方案结合EEG+VR,中风患者运动功能恢复速度提高40%

3. 教育培训:

– Labster虚拟实验室覆盖300+生物化学实验,教学成本降低85%

– Engage元宇宙平台举办跨国学术会议,碳减排达传统会议92%

三、技术发展瓶颈

1. 生理适配难题:

– 40%用户使用30分钟后出现视觉疲劳(IEEE VR 2025研究数据)

– 时延敏感阈值:运动到光子延迟需<20ms,现有设备平均为25-30ms 2. 内容生产瓶颈: - 高质量VR内容制作成本是2D视频的8-12倍 - 6DoF视频数据量达传统视频的60倍(8K@60fps) 3. 标准化挑战: - OpenXR 1.0标准仅覆盖60%设备功能接口 - 跨平台内容适配需额外30%开发工作量 四、未来技术路线 1. 光电技术突破: - 三星研发厚度1mm的全息光学元件(HOE) - JDI开发4032ppi Micro-OLED,像素密度提升300% 2. 感知扩展: - 卡内基梅隆大学研发电子舌接口,实现基本味觉模拟 - MIT触觉反馈薄膜可将振动频率提升至2000Hz 3. 云端渲染架构: - NVIDIA CloudXR支持5G网络下8K 120Hz串流 - 边缘计算节点延迟控制在8ms内(中国移动实测数据) 随着神经接口和量子计算的发展,VR系统正从视觉模拟向多模态感知进化。IDC预测2025年全球VR产业规模将达2800亿美元,其中企业级应用占比将超过60%。技术突破与产业需求的持续共振,正在重塑数字世界的交互范式。

点击右侧按钮,了解更多行业解决方案。

相关推荐

vr系统的组成

vr系统的组成

虚拟现实(VR)系统通过整合先进硬件与智能软件,构建出沉浸式数字体验。其核心组成可分为硬件平台、交互设备、计算与渲染系统、内容开发工具四大部分,各部分协同工作实现从物理世界到虚拟空间的跨越。

一、感知层硬件构成

1. 视觉呈现系统

头戴显示器(HMD)采用双OLED/LCD屏幕,提供110°以上视场角,搭配菲涅尔透镜或Pancake光学方案。Meta Quest Pro等设备已实现单眼2K分辨率与120Hz刷新率,配合动态注视点渲染技术优化资源分配。眼动追踪模块通过近红外摄像头实时捕捉瞳孔运动,为自适应光学调节提供数据支持。

2. 空间定位体系

Inside-out追踪系统集成6DoF IMU传感器与鱼眼摄像头,Vive Cosmos采用32点环境建模技术实现亚毫米级精度。Lighthouse激光基站系统通过飞行时间计算构建厘米级定位网络,SteamVR 2.0版本支持10×10米追踪范围。

3. 触觉反馈装置

Teslasuit全身动捕服集成130个触觉点,支持0.1N精度力反馈。HaptX Gloves通过微流体技术实现每平方厘米20点触觉反馈,延迟控制在15ms以内。Ultrahaptic技术利用超声波阵列实现空中触觉感知。

二、计算与渲染架构

图形处理单元采用NVIDIA RTX 4090级GPU,支持光线追踪与DLSS 3.0超采样技术。分布式计算框架通过CloudXR实现5G网络下20ms端到端延迟,NVIDIA Omniverse提供实时物理仿真引擎。异步时间扭曲(ATW)与空间扭曲(ASW)算法将渲染帧率提升至物理帧率的200%。

三、交互逻辑系统

手势识别采用Leap Motion的26骨骼点建模,识别精度达0.01毫米。自然语言处理模块集成BERT模型实现上下文感知对话,语音指令响应时间<200ms。认知负荷管理系统通过EEG生物传感器监测用户注意力状态,动态调整场景复杂度。 四、内容生产体系 Unity引擎支持实时全局光照(Enlighten)与物理材质系统(HDRP),Unreal Engine 5的Nanite几何系统可处理200亿多边形场景。Blender开源工具链提供从建模到动画的全流程解决方案,Substance 3D Designer实现程序化材质生成。OpenXR标准协议确保跨平台兼容性,WebXR技术拓展浏览器端VR应用。 当前VR系统正向多模态融合方向发展,Varjo XR-3已实现视频透视与虚拟场景的像素级融合,苹果Vision Pro通过12摄像头阵列构建毫米级环境重建。神经渲染技术的引入使系统能实时生成1024PPI级画质,5G边缘计算将云端渲染延迟压缩至8ms以内。这种硬件与软件的深度耦合,正在重塑人机交互的边界。

点击右侧按钮,了解更多行业解决方案。

VR系统

VR系统

虚拟现实(VR):重塑人类感知的下一代技术革命

在科技与想象力的交汇处,虚拟现实(Virtual Reality,简称VR)正以颠覆性的姿态重塑人类与数字世界的交互方式。通过头戴设备、传感技术与实时渲染,VR构建出一个可沉浸、可交互的三维虚拟空间,让用户跨越物理限制,在虚实交融的维度中重新定义“存在感”。这一技术不仅革新了娱乐方式,更在教育、医疗、工业等领域引发连锁变革,成为通向“元宇宙”的核心桥梁。

一、技术演进:从概念到沉浸式体验

VR的雏形可追溯至20世纪60年代,美国计算机科学家伊凡·苏泽兰发明了首个头戴式显示设备“达摩克利斯之剑”,其笨重的机械结构和线缆束缚揭示了技术原初的粗糙。21世纪后,随着显示技术、计算能力与动作捕捉技术的突破,VR迎来爆发式发展:2025年Oculus Rift消费级设备的推出标志着VR进入大众市场,2025年Meta Quest 2凭借无线设计与6DoF(六自由度)定位系统实现真正意义上的自由移动。如今,4K分辨率屏幕、120Hz刷新率与眼动追踪技术的结合,将延迟降至毫秒级,使虚拟场景的拟真度逼近现实临界点。

二、多领域渗透:重构产业逻辑

在游戏娱乐领域,VR彻底颠覆了传统“屏幕+手柄”的交互模式。《半衰期:爱莉克斯》等作品通过物理引擎与手势控制,让玩家以自然动作完成射击、解谜等操作,神经科学研究表明这种全沉浸体验能使多巴胺分泌量提升40%。教育领域,医学院利用VR解剖系统让学生无限次进行手术模拟,历史课堂借助3D重建技术重现庞贝古城的毁灭瞬间,实验证明VR教学可使知识留存率提高75%。工业场景中,波音公司采用VR进行飞机装配训练,将错误率降低50%;建筑师在虚拟空间中实时调整设计方案,客户参与度提升300%。

三、挑战与进化:通向元宇宙的必经之路

当前VR技术仍面临多重挑战。硬件方面,设备重量与续航能力的矛盾尚未解决,据斯坦福大学研究,超过30%用户因眩晕问题放弃长期使用,这源于前庭视觉冲突的生理机制。内容生态则呈现“游戏独大”的失衡状态,生产力工具占比不足15%。更严峻的是隐私安全危机——眼球追踪数据可能泄露用户注意力分布,空间定位信息足以还原真实生活轨迹。

这些痛点正驱动技术迭代:光波导技术使眼镜形态设备成为可能,Micro-OLED显示屏在0.5英寸面板实现4K分辨率;AI算法的介入能实时预测用户动作,将渲染延迟压缩至5ms以内;区块链技术则为虚拟资产确权提供解决方案。当5G网络铺就低时延数据传输通道,脑机接口突破神经信号解码瓶颈,VR将最终蜕变为“元宇宙”的神经中枢,实现《雪崩》预言的数字文明跃迁。

结语:虚实共生的未来镜像

从娱乐工具到生产力平台,VR的进化史本质是人类拓展感知边疆的征程。它既是一面镜子,映照出我们对突破物理束缚的永恒渴望;也是一把钥匙,正在打开通向平行数字宇宙的大门。当虚拟与现实的界限日益模糊,如何在技术创新与人文伦理间找到平衡点,将成为塑造下一代文明形态的关键命题。

点击右侧按钮,了解更多行业解决方案。

开源nvr系统

开源nvr系统

开源NVR系统:灵活高效的安防监控新选择

在数字化安防需求日益增长的今天,网络视频录像机(Network Video Recorder, NVR)作为监控系统的核心设备,承担着视频存储、管理与分析的重要职能。而开源NVR系统凭借其低成本、高定制化的特点,正成为企业、家庭乃至开发者的热门选择。

一、开源NVR的核心优势

1. 成本节约

与传统商业NVR动辄数千元的授权费用不同,开源解决方案(如Shinobi、ZoneMinder)允许用户免费部署在自有硬件上,仅需投入服务器成本即可构建专业级监控平台。企业可将节省的预算用于扩展摄像头数量或升级存储设备。

2. 深度定制能力

开源代码赋予用户二次开发自由。开发者可基于Python、Node.js等语言修改功能模块,例如:

- 集成人脸识别算法(如OpenCV)

- 添加车牌识别或行为分析功能

- 对接智能家居系统实现联动控制

3. 协议兼容性强

主流开源NVR支持ONVIF、RTSP等标准协议,可兼容3000+型号的网络摄像机,避免厂商绑定风险。用户可混合使用海康威视、大华、TP-Link等不同品牌设备。

4. 数据主权保障

所有视频数据存储在本地服务器,避免云服务潜在的隐私泄露风险,符合GDPR等数据保护法规要求,尤其适合政府、医疗机构等敏感场景。

二、五大主流开源方案对比

1. Shinobi

- 优势:基于Node.js开发,支持H.265解码与4K流;提供移动端适配界面

- 适用场景:中小型企业多摄像头管理,支持云端备份至AWS/S3

2. ZoneMinder

- 特点:老牌开源项目,内置运动检测算法,可通过MySQL记录事件日志

- 扩展:支持Python插件开发,可与HomeAssistant智能家居平台集成

3. Kerberos.io

- 创新点:采用微服务架构,支持Docker部署;专注边缘计算,可在树莓派运行

- 技术亮点:基于AI的运动区域标记,减少误报警

4. MotionEye

- 简易性:提供Web可视化配置界面,适合家庭用户快速搭建

- 功能:支持定时录像、动态检测推送Telegram通知

5. Frigate

- AI强化:集成Google Coral TPU加速,实现实时人/车/宠物识别

- 性能:单服务器可处理40+路1080P视频流分析

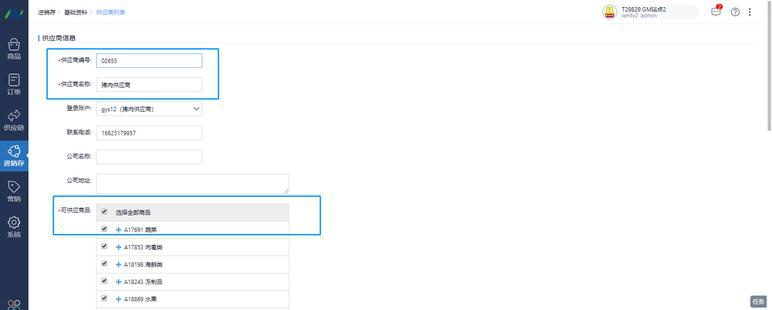

三、典型部署架构示例

以中型超市监控为例:

1. 硬件层:旧服务器改装(Intel i5/16GB RAM/4TB HDD×2 RAID1)

2. 接入层:8台4MP POE摄像头通过交换机连接

3. 软件栈:Ubuntu Server + Docker运行Shinobi Core

4. 智能分析:基于YOLOv5模型检测货架缺货状态

5. 存储策略:关键时段视频保留90天,运动事件视频永久存档

四、挑战与应对策略

1. 技术门槛问题

- 方案:提供预配置的OVA虚拟机模板,用户可直接导入VMware使用

- 社区:搭建中文论坛(如国内GitCode镜像),提供详细Wiki文档

2. 硬件兼容性优化

- 建议采用Intel Quick Sync Video技术提升解码效率

- 使用SSD缓存层加速高并发视频写入

3. 商业支持缺失

- 可选购企业版服务(如Shinobi Pro提供工单支持)

- 结合Elastic Stack实现集中化日志监控

五、未来演进方向

随着边缘AI芯片的普及,开源NVR正朝着"端-边-云"协同架构发展。例如Kerberos.io 4.0版本已支持在摄像头端运行轻量级分析模型,仅将关键事件视频回传中心服务器,可降低80%带宽消耗。同时,WebRTC技术的融入使得浏览器直接播放视频流无需插件,极大提升移动端访问体验。

对于追求自主可控的组织,开源NVR不仅是成本优化方案,更是构建智能安防生态的基础平台。通过结合AIoT技术,未来的监控系统将实现从被动记录到主动风险预警的跨越式升级。

点击右侧按钮,了解更多行业解决方案。

免责声明

本文内容通过AI工具智能整合而成,仅供参考,e路人不对内容的真实、准确或完整作任何形式的承诺。如有任何问题或意见,您可以通过联系1224598712@qq.com进行反馈,e路人收到您的反馈后将及时答复和处理。